L'autre jour j'avais un bug en production. Quelque chose s'affichait mal dans l'interface et je n'arrivais pas a trouver d'ou ca venait. J'ai passe l'URL a Claude, il a ouvert Chrome, inspecte le HTML dans le navigateur, croise ce qu'il voyait dans le DOM avec mon code source, et trouve la ligne exacte ou se trouvait l'erreur. Pas le fichier; la ligne. Il a navigue entre le rendu et le codebase, fait correspondre ce qui etait casse a l'ecran avec le composant qui le produisait, et m'a pointe vers le correctif.

Ce moment m'est reste. Pas parce que l'IA m'a fait gagner du temps (elle le fait quotidiennement), mais pour ce que ca revelait sur la nature de la reponse. Le modele ne savait pas ou etait le bug. Il l'a infere. Il a observe le HTML rendu, estime quelles parties du code pouvaient produire ce resultat, et fait remonter l'origine la plus probable. Cette inference probabiliste entre deux representations differentes du meme systeme; navigateur et codebase; etait plus efficace que mon debogage deterministe ne l'aurait ete.

Nous vivons quelque chose de plus grand que ce que la plupart realisent. Le passage de l'informatique deterministe a l'informatique probabiliste n'est pas une simple amelioration technique. C'est un changement dans la facon dont le savoir se cree.

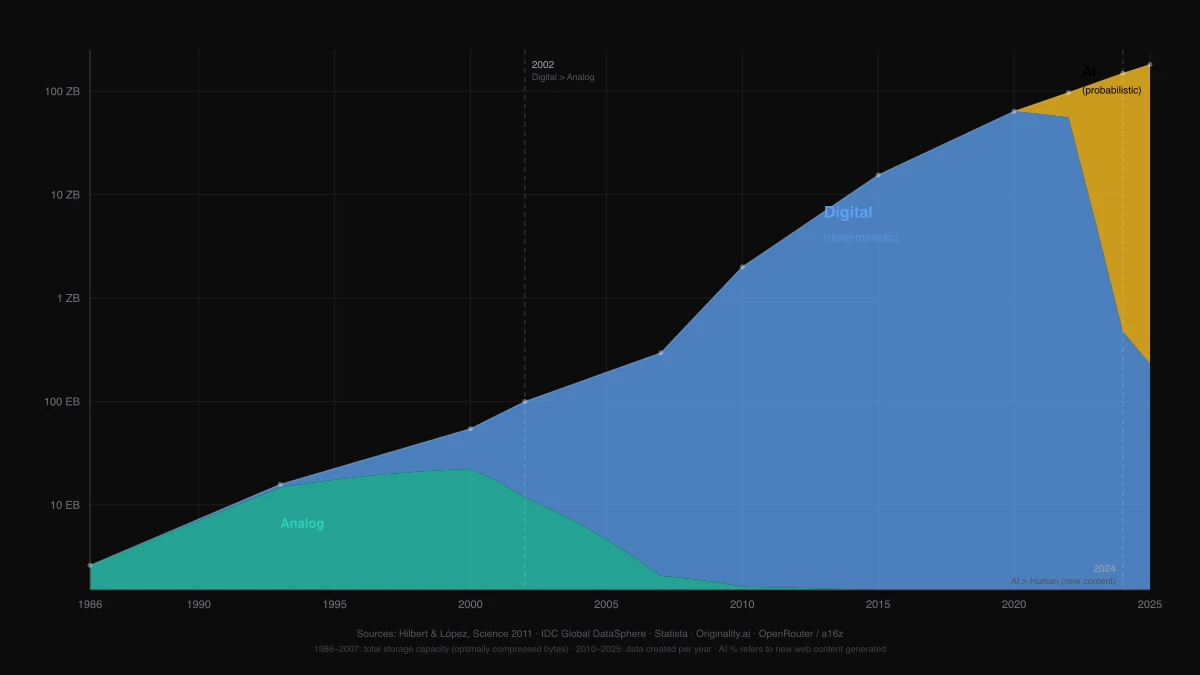

Le premier changement de paradigme : de l'analogique au numerique

Le passage de l'analogique au numerique a ete la transition technologique marquante de la fin du XXe siecle. Il a converti les signaux continus en donnees discretes. Du jour au lendemain on pouvait copier l'information sans degradation. La transmettre mondialement. La stocker efficacement. Internet, les systemes distribues, le logiciel moderne; tout descend de cette idee unique : les signaux continus peuvent etre representes comme des sequences de uns et de zeros.

Mais il y avait quelque chose que cette transition n'a pas touche : le processus de creation lui-meme.

Le logiciel numerique est deterministe. Pour une meme entree, il produit la meme sortie. Chaque ligne de code, chaque systeme, chaque produit devait etre explicitement concu, ecrit et maintenu par un humain. L'ordinateur executait des instructions. Il ne generait rien qu'on ne lui avait dit de generer. Un formateur SQL formate du SQL parce que quelqu'un a ecrit les regles exactes du formatage. Un generateur de mots de passe produit des chaines aleatoires parce que quelqu'un a implemente des algorithmes CSPRNG qui definissent precisement comment l'aleatoire se produit.

Les systemes deterministes sont previsibles, testables et fiables. Ils sont aussi fondamentalement limites : ils ne peuvent faire que ce que quelqu'un a deja imagine et code.

Le second changement de paradigme : du determinisme au probabilisme

Avec les grands modeles de langage et l'apprentissage profond, nous sommes entres dans une nouvelle phase. Des systemes qui n'executent pas d'instructions rigides mais generent des resultats bases sur des distributions de probabilite.

La difference est structurelle :

- On ne decrit plus exactement quoi faire. On entraine des modeles a apprendre comment le faire.

- On ne genere plus l'information manuellement. On l'infere.

- On produit des reponses, du contenu et des decisions qui n'ont jamais ete programmes explicitement.

Pensez a ce que fait un detecteur de contenu IA. Il n'a pas de liste de "phrases ecrites par l'IA" a comparer. Il calcule les proprietes statistiques du texte; conformite a la loi de Zipf, entropie de ponctuation, distributions de longueur de phrases; et estime une probabilite que le texte ait ete genere par une machine. Le detecteur lui-meme est un systeme probabiliste analysant la sortie d'un autre systeme probabiliste. C'est une phrase qui n'aurait eu aucun sens il y a dix ans.

Ou pensez a la generation automatique de sous-titres. Le modele Whisper d'OpenAI ne suit pas de regles if-then pour transcrire la parole. Il traite des spectrogrammes audio et predit la sequence de tokens la plus probable correspondant a ce qui a ete dit. Il a raison la plupart du temps. Pas tout le temps. Ce "la plupart du temps" est la caracteristique fondamentale des systemes probabilistes.

Ce changement a un impact direct sur la ressource la plus precieuse : le temps. L'IA reduit d'ordres de grandeur l'effort necessaire pour creer, analyser et predire.

Generation de savoir sans precedent

La difference cle est que les systemes probabilistes peuvent travailler avec l'inconnu. A partir de patterns appris, ils peuvent :

- Generer du texte, des images ou du code qui n'ont jamais existe.

- Predire des resultats futurs a partir de donnees incompletes.

- Trouver des relations qui n'ont jamais ete explicitement definies.

Cela brise une contrainte historique : on n'a plus besoin d'ecrire chaque cas possible. Le systeme peut generaliser.

Prenez le forecaster Monte Carlo. La gestion de projet classique demandait aux equipes d'estimer la duree des taches puis additionnait les chiffres. La simulation Monte Carlo fait quelque chose de plus intelligent : elle lance des milliers de scenarios a partir de donnees historiques et vous donne une distribution de probabilite des dates de livraison. "Il y a 85% de chances que vous finissiez avant le 15 mars" est plus utile que "l'estimation est le 10 mars." Mais il y a une nuance importante : Monte Carlo est du code deterministe. Des formules statistiques executees avec une precision parfaite. Il n'y a pas d'inference; il y a simulation. C'est de la pensee probabiliste implementee sur une infrastructure deterministe. Aujourd'hui un LLM pourrait faire la meme prediction sans tout ce code; vous lui passez les donnees historiques de l'equipe et il vous donne une estimation raisonnable. Mais "raisonnable" n'est pas "fiable". Tant que les modeles n'atteignent pas 99,99% de precision, les simulations statistiques codees a la main restent le choix sur. Monte Carlo est exactement le type d'outil qui marque la transition : une pensee probabiliste qui a encore besoin de bequilles deterministes.

Le meme principe s'applique partout. Un suppresseur d'arriere-plan executant un reseau neuronal dans le navigateur n'a pas de regles sur ce qui constitue un "arriere-plan". Il a appris des distributions de probabilite sur des millions d'images segmentees et les applique a votre photo. Un generateur de prompts ne stocke pas de prompts pre-ecrits; il structure des patterns de langage naturel qui produisent probabilistiquement de meilleurs resultats du modele.

Meme les outils purement deterministes sont transformes. La conversion HTML en Markdown est deterministe; le meme HTML produit toujours le meme Markdown. Mais la raison pour laquelle cet outil existe est probabiliste : les gens ont besoin de Markdown propre parce que nourrir du HTML brut a un LLM gaspille 60-80% des tokens en bruit structurel. Un outil deterministe au service d'un ecosysteme probabiliste.

Les limitations actuelles : pourquoi ce n'est pas encore parfait

Malgre le potentiel, l'IA actuelle a des contraintes reelles :

Temps d'inference. Generer des reponses implique de traiter des quantites enormes de tokens. Une chaine de raisonnement complexe dans un modele de pointe peut prendre 30-60 secondes. C'est rapide compare a l'analyse humaine, mais lent compare a une requete en base de donnees. L'ecart de latence entre "calculer un hash" (nanosecondes) et "raisonner sur un bug" (secondes) est de six ordres de grandeur.

Erreurs probabilistes. Les modeles ne "savent" pas au sens classique. Ils estiment. En avril 2026, GPT-5.5, Claude Opus 4.7 et Gemini 3.1 Pro obtiennent entre 89% et 92% sur MMLU-Pro; le benchmark plus exigeant qui remplace le MMLU original. Chaque generation gagne quelques points, mais les chiffres restent statistiques. Un animateur de parcours de graphe trouvera toujours le plus court chemin parce que BFS est deterministe. Un LLM a qui on demande de trouver le plus court chemin le trouvera probablement, mais il pourrait halluciner une arete inexistante.

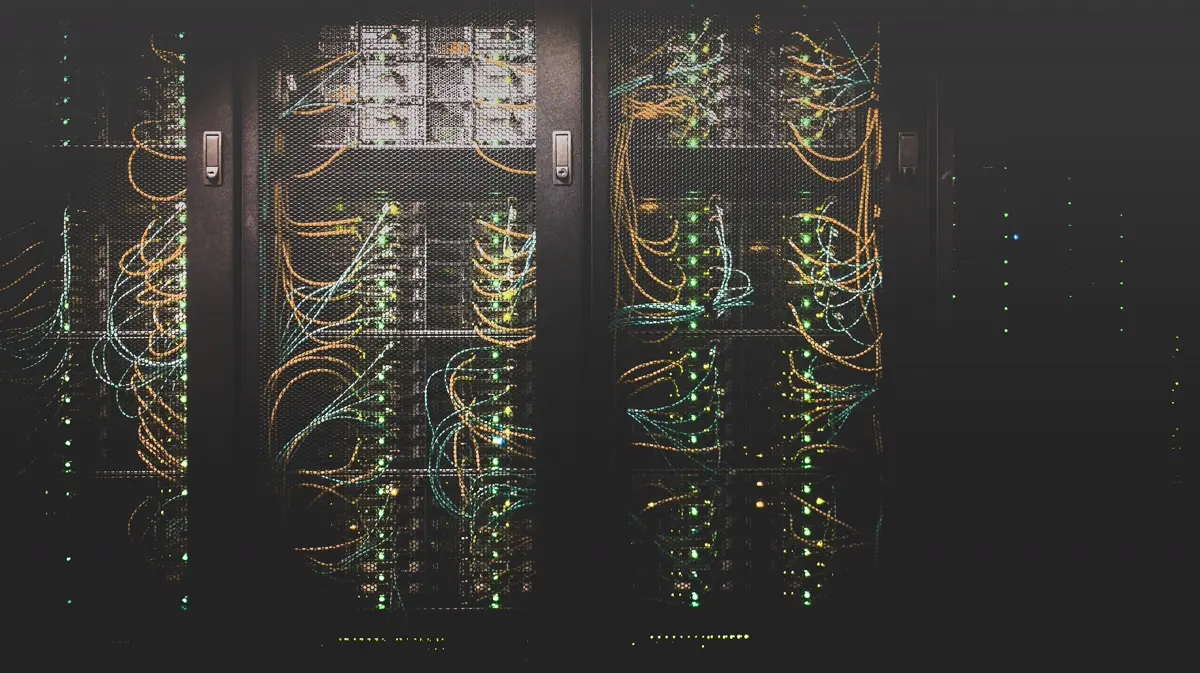

Infrastructure classique. Ces modeles tournent sur du materiel concu pour le calcul deterministe : CPUs, GPUs, TPUs. Le NVIDIA H100 est optimise pour la multiplication matricielle massive, ce dont les transformers ont besoin, mais l'architecture sous-jacente reste classique. Nous resolvons des problemes probabilistes avec des machines deterministes.

La trajectoire : vers 100% de precision

La tendance est claire. Chaque nouvelle generation de modeles s'ameliore sur les benchmarks, reduit les taux d'erreur et etend la capacite de generalisation. Les familles Gemini de Google, Claude d'Anthropic et GPT d'OpenAI convergent vers des niveaux de precision qui rendent la distinction entre "correct" et "hautement probable" pratiquement sans objet pour de nombreuses taches.

Quand les modeles atteindront 99,99% de precision sur les taches cognitives courantes :

- La confiance dans les systemes d'IA egalera ou depassera la confiance dans le jugement humain.

- La plupart des taches intellectuelles suivant des patterns apprenables seront entierement deleguees.

- Le cout marginal de generation de savoir approchera de zero.

Nous n'y sommes pas encore. Mais la distance se reduit a chaque nouvelle version.

Le goulot d'etranglement : calcul classique vs. calcul quantique

Voici une idee qui merite reflexion : nous resolvons un probleme fondamentalement probabiliste avec des outils deterministes.

Les GPUs et TPUs parallelisent des calculs massifs, mais ils fonctionnent selon des principes classiques. Cela cree des contraintes reelles :

- Forte consommation energetique. L'entrainement de modeles de classe GPT-5 a necessité des dizaines de milliers de GPUs NVIDIA H100 pendant des mois, a des couts depassant 100 millions de dollars.

- Mise a l'echelle couteuse. Plus de parametres signifie plus de materiel, plus de refroidissement, plus d'electricite.

- Latences significatives sur les grands modeles.

L'alternative theorique est le calcul quantique.

Des entreprises comme IBM, Google et D-Wave Systems explorent les QPUs (Quantum Processing Units) qui travaillent directement avec des etats probabilistes via la superposition et l'intrication.

En theorie, cela permettrait :

- De resoudre certains calculs exponentiellement plus vite.

- De modeliser des systemes probabilistes nativement au lieu de les simuler sur du materiel deterministe.

- De reduire drastiquement le cout computationnel de l'inference IA.

Si vous voulez voir a quoi ressemblent les circuits quantiques, le Simulateur de Circuits Quantiques vous permet de construire et d'executer des circuits dans le navigateur. Deux lignes de code creent un etat de Bell; une paire de qubits maximalement intrigues ou la mesure de l'un determine instantanement l'autre. Ce type de comportement probabiliste natif est exactement ce qui manque a l'infrastructure IA actuelle.

Le probleme difficile : correction d'erreur quantique

Le calcul quantique n'est pas encore pret pour ce role. Le principal obstacle est la Correction d'Erreur Quantique.

Les systemes quantiques sont extremement sensibles au bruit et aux interferences. Chaque interaction avec l'environnement peut effondrer la superposition d'un qubit, corrompant le calcul. Les processeurs quantiques actuels ont des taux d'erreur qui les rendent impraticables pour le calcul soutenu et fiable que necessite l'inference IA.

Pour qu'un QPU soit viable a grande echelle, trois choses doivent se produire :

- Les taux d'erreur doivent chuter drastiquement. Les qubits physiques actuels ont des taux d'erreur autour de 0,1-1%. Le calcul quantique utile necessite des taux inferieurs a 0,0001%.

- Le nombre de qubits stables doit augmenter. La feuille de route d'IBM vise 100 000 qubits d'ici 2033. C'est ambitieux, mais les defis d'ingenierie a chaque etape sont enormes.

- Les architectures tolerantes aux pannes doivent murir. Les codes de surface et autres schemas de correction d'erreur fonctionnent en principe mais necessitent des milliers de qubits physiques par qubit logique. Le surcout est encore prohibitif.

L'enjeu n'est pas que la vitesse. C'est l'energie.

Les centres de donnees ont consomme environ 415 TWh en 2024; 1,5% de l'electricite mondiale. L'AIE estime qu'ils depasseront 1 000 TWh d'ici 2026, avec l'IA comme principal moteur de croissance. Entrainer un modele de pointe consomme l'equivalent en electricite de milliers de foyers pendant un an. Chaque requete d'inference brule plus de 33 Wh sur les longs prompts; dix fois ce qu'une recherche Google utilise. Et ca monte. Plus de modeles, plus d'agents, plus de robotique avec IA embarquee; chaque couche ajoute de la demande energetique.

Le jour ou la correction d'erreur quantique sera resolue, cette equation change radicalement. Les QPUs actuels consomment environ 25 kW, principalement pour le refroidissement cryogenique; pas pour le calcul. Mais le calcul quantique travaille avec le probleme probabiliste nativement au lieu de le simuler avec des billions de multiplications matricielles. Les algorithmes de compression quantique demontrent deja des gains d'efficacite energetique de 84% sur des taches IA specifiques. Et la correction d'erreur partielle permet a des modeles quantiques de maintenir une haute precision avec des milliers de qubits au lieu de millions.

Quand la correction d'erreur quantique murira, nous n'aurons pas simplement une IA plus rapide. Nous aurons une IA qui consomme des ordres de grandeur moins d'energie par inference. C'est ce qui transforme le calcul quantique d'une curiosite de laboratoire en infrastructure viable pour les milliards d'agents que l'avenir exige.

D'ici la, nous continuerons a executer de l'IA probabiliste sur du materiel deterministe. Ce qui, honnetement, fonctionne remarquablement bien vu a quel point les paradigmes sont fondamentalement incompatibles.

Ce que ca signifie en pratique

Ce n'est pas de la philosophie abstraite. Le passage du determinisme au probabilisme change la facon dont on construit, dont on travaille et dont on pense les outils.

Un laboratoire d'arbres binaires de recherche enseigne les algorithmes deterministes. Inserez un noeud, parcourez l'arbre, obtenez le meme resultat a chaque fois. Ce type de certitude reste precieux. Les bases de donnees ont toujours besoin de B-trees. Le routage a toujours besoin de Dijkstra. Les generateurs de bruit bleu ont toujours besoin d'algorithmes d'echantillonnage deterministes pour produire des points bien distribues.

Mais la couche au-dessus de ces primitives deterministes est de plus en plus probabiliste. La requete en base est deterministe; l'agent IA qui decide quelle requete executer est probabiliste. L'algorithme est deterministe; le modele qui selectionne quel algorithme convient au probleme est probabiliste. Le texte est deterministe une fois ecrit; le systeme qui extrait du texte d'images via des reseaux neuronaux OCR est probabiliste.

Nous construisons une pile ou les systemes deterministes executent et les systemes probabilistes decident. C'est nouveau. Et ca ne va que s'accelerer.

La prochaine etape n'est pas une meilleure IA; c'est une pile de calcul composable

Ce qui vient ensuite ne remplace pas un paradigme par un autre. Ca les compose.

Pensez a comment l'infrastructure moderne fonctionne deja. Les CPUs executent de la logique deterministe; transactions de base de donnees, verification cryptographique, le noyau de votre systeme d'exploitation. Les GPUs et TPUs resolvent des problemes probabilistes; ils entrainent des modeles, executent l'inference, traitent des distributions sur des millions de parametres. Chaque couche fait ce que l'autre ne peut pas. Personne ne propose de remplacer les CPUs par des GPUs. On les combine.

Les QPUs completent la troisieme couche. Ils resolvent une classe de problemes que le materiel classique simule mal : optimisation combinatoire, echantillonnage de distributions en haute dimension, recherche dans des espaces exponentiels. L'inference IA ne devient pas juste plus rapide; elle devient viable a des echelles actuellement insolvables.

La pile ressemble a ceci : les systemes deterministes executent et verifient. Les systemes probabilistes proposent et generent. Les systemes quantiques optimisent ce qu'aucun des deux autres ne peut toucher.

Mais il y a un element dont presque personne ne parle encore.

Des modeles qui parlent a des machines qui parlent a des modeles

Jusqu'ici on pense a l'IA comme quelque chose qui recoit un prompt et renvoie du texte. C'est comme penser qu'Internet c'est le mail. La prochaine couche est la communication entre modeles probabilistes; et entre ces modeles et le materiel deterministe qu'ils controlent.

Un modele de langage analyse des donnees de capteurs et decide qu'il a besoin de plus d'information d'une zone specifique. Il communique cette decision a un modele de vision controlant un drone. Le drone se deplace, collecte des donnees, les traite via un autre modele specialise, et renvoie les resultats au premier. Aucun humain n'est intervenu dans le cycle. Aucun humain n'a decide que cette zone etait interessante. Le systeme l'a infere.

Ce n'est pas de l'automatisation. L'automatisation execute ce qu'un humain a concu. Ceci est different : des systemes probabilistes qui decident quelles donnees collecter, comment les collecter, et quoi faire de ce qu'ils trouvent. Des robots avec des modeles d'IA qui choisissent d'explorer des sources d'information auxquelles nous n'aurions pas pense.

Imaginez un drone marin avec des capteurs chimiques et un modele entraine sur la biodiversite oceanique. Il ne suit pas un itineraire preprogramme. Il detecte une anomalie dans la composition de l'eau, infere qu'elle pourrait indiquer une communaute microbienne inconnue, ajuste sa trajectoire et prend des echantillons. Il trouve quelque chose qu'aucun biologiste marin n'aurait cherche parce qu'aucun n'aurait predit que ce serait la. Un autre modele analyse les echantillons, identifie des composes au potentiel pharmaceutique, et demande au drone de retourner dans la meme zone avec des capteurs differents.

C'est du savoir genuinement nouveau. Pas extrait de donnees existantes ni infere a partir de texte humain. Genere par un systeme qui a decide d'aller le chercher.

Quand la prediction prend des nanosecondes

Les limitations actuelles sont reelles. L'inference prend des secondes. La precision oscille entre 86 et 95% selon le benchmark. Mais ce sont les limitations de la premiere generation d'un paradigme qui demarre a peine. La trajectoire pointe vers des modeles avec 99,99% de precision et des temps de reponse en nanosecondes.

Quand cela arrivera, le monde se reorganise de facons difficiles a imaginer depuis notre position actuelle.

Une voiture autonome qui met 30 millisecondes a decider est une voiture qui freine tard. Une qui decide en nanosecondes reagit avant que l'obstacle finisse d'apparaitre. Un reseau de modeles medicaux avec 99,99% de precision n'assiste pas le medecin; il diagnostique avec une fiabilite qu'aucun humain ne peut egaler. Une chaine d'approvisionnement ou chaque noeud a un modele predictif communicant avec tous les autres n'a pas besoin de planification trimestrielle; elle se reoptimise en temps reel, chaque milliseconde.

Mais le plus important est ce qui se passe quand l'inference probabiliste devient si rapide et precise qu'elle est fonctionnellement indiscernable de la certitude deterministe. La distinction entre "calculer" et "inferer" disparait. Votre systeme d'exploitation n'a pas besoin de distinguer entre une operation arithmetique et une prediction. Le compilateur n'a pas besoin de savoir si le resultat vient de la logique formelle ou d'un modele a 400 milliards de parametres. C'est tout du calcul; en partie base sur des regles, en partie sur des distributions, en partie optimise quantiquement. Integre de facon transparente.

L'IA cesse d'etre un outil qu'on ouvre et devient une couche d'infrastructure qu'on ne remarque meme plus. Comme l'electricite. Comme TCP/IP. C'est partout et on n'y pense pas.

Savoir au-dela de l'humain

Les robots avec des modeles d'IA n'automatisent pas seulement ce que nous faisions. Ils percoivent ce que nous ne pouvons pas.

Un capteur ultrasonique couple a un modele de materiaux detecte des microfissures dans une eolienne qu'aucune inspection visuelle ne trouverait. Un spectrometre portable avec un modele chimique identifie des polluants a des concentrations que les protocoles humains ne mesurent pas. Un reseau d'hydrophones avec un modele acoustique classifie des especes marines par des patterns sonores qu'aucun biologiste n'a encore catalogues.

Ce ne sont pas des ameliorations incrementales d'efficacite. Ce sont de nouvelles sources de savoir. Des donnees qui existaient dans le monde physique mais qui nous etaient invisibles parce que nous n'avions pas les bons capteurs couples a la bonne intelligence pour les interpreter.

Et c'est la que la boucle se ferme. Ces robots ne collectent pas seulement des donnees; les modeles qu'ils embarquent decident quelles donnees meritent d'etre collectees. Mais le cycle va plus loin. Une IA analysant des anomalies de temperature oceanique determine que le reseau de capteurs existant est trop grossier; elle a besoin de mesures a des profondeurs et des frequences qu'aucun instrument actuel ne couvre. Alors elle concoit la specification d'un nouveau capteur. Un robot de fabrication le construit. Un robot de deploiement l'installe sur une flotte de drones sous-marins. Ces drones collectent des donnees qu'aucun systeme precedent ne pouvait capturer, et ces donnees entrainent un meilleur modele, qui identifie la prochaine lacune en capacite de mesure, et le cycle recommence.

Aucun humain n'a decide quoi mesurer. Aucun humain n'a concu le capteur. Aucun humain n'a choisi ou le deployer. Toute la chaine; de l'identification d'une lacune de connaissances a son comblement par du materiel physique nouveau; a ete pilotee par l'inference probabiliste.

Quand des millions de tels systemes fonctionnent simultanement, chacun concevant des capteurs pour les autres, deployant des instruments qui n'existaient pas un cycle avant, et renvoyant les resultats vers des modeles partages, l'humanite accede a une couche de realite qu'elle ne pouvait litteralement pas percevoir avant. Ce n'est pas une amelioration de ce que nous savions deja. C'est l'acces a ce que nous ne savions pas que nous ne savions pas.

La pile complete

Il y a trente ans la question etait "tu sais coder ?". Il y a dix ans c'etait "tu sais utiliser des APIs ?". Aujourd'hui c'est "tu sais diriger des modeles ?". Demain ce sera sans objet; les modeles se dirigeront entre eux.

Les systemes deterministes executent et verifient. Les systemes probabilistes proposent, generent et decident. Les systemes quantiques optimisent l'insoluble. Les capteurs et robots etendent tout cela dans le monde physique. Et la communication entre modeles ferme la boucle : des systemes qui decouvrent ce qu'ils ne savent pas, decident comment le trouver, et agissent pour l'obtenir. Sans intervention humaine. Sans que personne ne leur dise ou chercher.

Si le passage de l'analogique au numerique a redefini comment nous stockons l'information, et si le passage du determinisme au probabilisme redefini comment nous generons le savoir, l'integration complete; modeles, materiel, capteurs, robots, calcul quantique; redefini les limites de ce qu'il est possible de percevoir et de comprendre.

Nous n'utiliserons pas de meilleurs outils. Nous serons entoures d'une intelligence qui voit ce que nous ne voyons pas, cherche ce que nous ne cherchons pas, et trouve ce que nous ne savions pas qu'il existait.